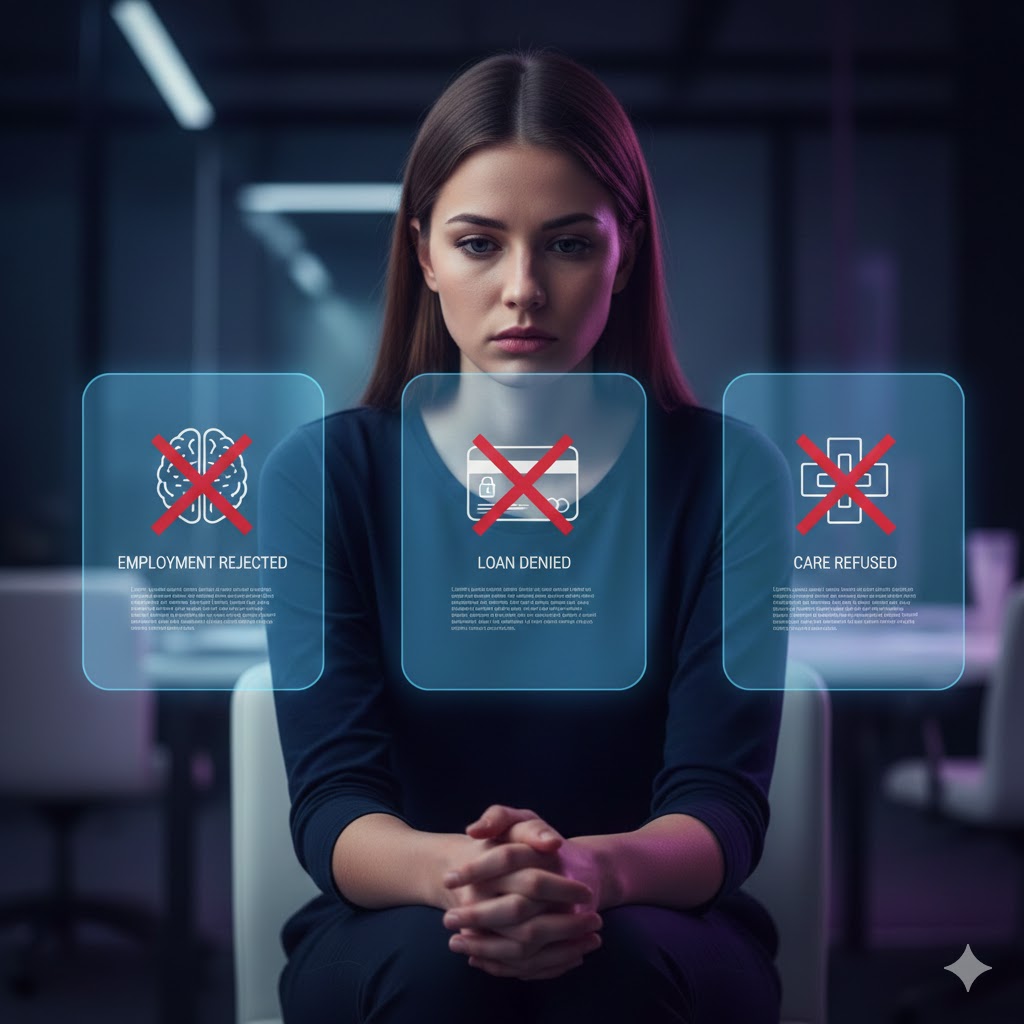

Une IA peut vous refuser un emploi, un crédit ou des soins — sans explication.

L’IA peut-elle décider de votre avenir ?

L’intelligence artificielle s’immisce dans les rouages les plus intimes de nos vies, bien au-delà des assistants vocaux ou des recommandations de films. Elle est devenue un acteur silencieux, mais puissant, capable d’influencer des moments charnières de notre existence. La question n’est plus de savoir si l’IA prend des décisions, mais plutôt de comprendre l’ampleur de son pouvoir et les conséquences de ses jugements.

Imaginez un instant : aujourd’hui une IA peut vous refuser un emploi, un crédit ou un traitement médical… sans que personne ne sache vraiment pourquoi. Ce scénario, loin d’être une fiction futuriste, est déjà une réalité tangible. Il soulève des interrogations fondamentales sur la justice, l’équité et le contrôle humain face à des systèmes de plus en plus autonomes.

Comprendre l’impact de l’IA sur les décisions

L’intégration de l’IA dans les processus décisionnels est un phénomène qui s’accélère. Des entreprises aux institutions publiques, les algorithmes sont déployés pour optimiser, analyser et trancher. Cette omniprésence transforme radicalement la manière dont les choix critiques sont formulés et appliqués, touchant directement les individus.

Le choc réside dans le fait que ces systèmes ne se contentent pas d’assister ; ils décident. Et souvent, ces décisions sont prises au sein d’une véritable « boîte noire algorithmique ». Même les ingénieurs qui ont conçu ces systèmes ne peuvent pas toujours expliquer précisément pourquoi une décision spécifique a été rendue. L’humain, dans ce contexte, devient parfois un simple validateur, loin d’être le décideur final.

Cette réalité est d’autant plus préoccupante que l’IA, malgré son apparente neutralité, peut véhiculer des biais invisibles. Ces biais, souvent hérités des données d’entraînement, peuvent discriminer sans intention consciente, affectant des critères comme le genre, l’origine, l’âge ou le lieu de résidence. La perte de contrôle humain sur des décisions vitales est une conséquence directe de cette opacité grandissante.

L’IA qui refuse : emploi, crédit, soins

Les exemples concrets de l’influence de l’IA sur nos vies sont nombreux et souvent alarmants. Dans le domaine du recrutement, une IA peut éliminer votre CV avant même qu’un œil humain ne le parcoure, pour une raison inconnue. Des études montrent que l’IA, si elle n’est pas bien encadrée, peut reproduire et amplifier les discriminations existantes, par exemple en favorisant certains profils au détriment d’autres, sans justification objective.

Pour l’accès au crédit, un algorithme bancaire peut refuser votre prêt sans fournir d’explication claire, vous laissant sans recours évident. Ce manque de transparence rend difficile la contestation et la compréhension des critères qui ont mené à cette décision. Le secteur financier, comme d’autres, s’appuie de plus en plus sur des scores automatisés qui peuvent vous suivre toute votre vie numérique, influençant bien plus que votre simple capacité d’emprunt.

Dans le secteur médical, une IA pourrait classer votre dossier comme “non prioritaire”, impactant potentiellement l’accès à des soins urgents ou spécialisés. Bien que l’IA puisse améliorer l’efficacité et le diagnostic, le risque d’une décision algorithmique erronée ou biaisée, sans supervision humaine adéquate, est une préoccupation majeure. La santé est un domaine où l’erreur n’est pas une option, et l’opacité des systèmes d’IA est particulièrement dangereuse.

Nos droits face aux algorithmes

Face à cette montée en puissance des systèmes d’IA, la question des droits individuels devient primordiale. Le droit à une explication, le droit de contester une décision automatisée et le droit à une intervention humaine sont des piliers essentiels pour garantir la justice et l’équité. Les régulations, comme l’AI Act européen, commencent à poser les bases d’un cadre légal, mais leur application reste un défi.

Il est crucial que les citoyens soient informés de l’utilisation de l’IA dans les décisions qui les concernent. La possibilité de demander une révision humaine d’une décision algorithmique est une garantie fondamentale. Sans cela, nous risquons de nous retrouver dans un système où les machines jugent sans appel, et où les individus sont impuissants face à des verdicts incompréhensibles.

La protection des données personnelles est également au cœur de cette problématique. Les IA se nourrissent de vastes quantités d’informations, et il est impératif de s’assurer que ces données sont collectées et utilisées de manière éthique et légale. Le respect de la vie privée et la minimisation des données sont des principes à défendre avec vigueur pour éviter toute dérive.

L’IA décide sans s’expliquer

La transparence et l’explicabilité sont les pierres angulaires d’une IA responsable. Un système transparent permet de comprendre comment il fonctionne, tandis qu’un système explicable peut justifier ses décisions de manière intelligible pour un humain. Atteindre ces objectifs est un défi technique et éthique considérable, car de nombreuses IA, notamment les modèles d’apprentissage profond, sont intrinsèquement complexes et opaques.

Développer des IA explicables signifie concevoir des algorithmes capables de fournir des raisons claires et compréhensibles derrière leurs choix. Cela va au-delà de la simple performance technique ; il s’agit de bâtir la confiance et de permettre aux utilisateurs de comprendre et de contester si nécessaire.

Les chercheurs et les régulateurs travaillent activement sur des méthodes pour rendre les IA plus transparentes. Cela inclut des techniques d’interprétabilité, des audits réguliers des algorithmes et la mise en place de comités éthiques. L’objectif est de passer d’une “boîte noire” à un système dont les mécanismes, même complexes, peuvent être démystifiés et compris par des experts et, dans une certaine mesure, par le grand public.

Se protéger contre les biais de l’IA

La lutte contre les biais de l’IA est une priorité absolue. Ces biais peuvent être involontaires, mais leurs conséquences sont bien réelles et peuvent perpétuer ou amplifier les inégalités sociales. La première étape consiste à identifier ces biais, ce qui nécessite une analyse rigoureuse des données d’entraînement et des performances des algorithmes sur différents groupes démographiques.

Des solutions techniques existent pour atténuer les biais, comme l’utilisation de données d’entraînement plus diversifiées et représentatives, ou le développement d’algorithmes conçus pour être équitables. Cependant, la technologie seule ne suffit pas. Une approche multidisciplinaire, impliquant des experts en éthique, en sociologie et en droit, est essentielle pour aborder la complexité de ces enjeux.

La mise en place de cadres réglementaires robustes est également une voie prometteuse. L’AI Act, par exemple, classe certains usages de l’IA comme “à haut risque” (notamment le recrutement) et impose des exigences strictes en matière de transparence, de supervision humaine et de gestion des risques. Ces régulations visent à protéger les citoyens et à garantir que l’IA est développée et utilisée de manière responsable.

L’importance de la formation et de la sensibilisation

Pour naviguer dans ce nouveau paysage, la formation et la sensibilisation à l’IA sont cruciales. Il ne s’agit pas de devenir des experts en codage, mais de comprendre les principes fondamentaux de l’IA, ses capacités et ses limites. Une meilleure compréhension permet aux citoyens de poser les bonnes questions, de déceler les risques et de défendre leurs droits.

Les entreprises et les institutions ont également un rôle majeur à jouer en formant leurs équipes à l’utilisation éthique de l’IA. Les professionnels doivent être capables d’identifier les biais, de comprendre les décisions algorithmiques et d’intervenir lorsque cela est nécessaire. L’humain doit rester au centre du processus, même lorsque l’IA assiste ou prend des décisions.

En fin de compte, l’avenir de l’IA dépendra de notre capacité collective à la maîtriser, à la comprendre et à l’encadrer. Il est impératif de ne pas laisser la technologie évoluer sans une réflexion éthique et sociale approfondie. C’est en cultivant une citoyenneté numérique éclairée que nous pourrons garantir que l’IA serve l’intérêt général et non l’inverse !

Par Près du Web